Vous êtes-vous déjà retrouvé à chercher désespérément l’outil parfait pour votre entreprise, celui qui correspondrait exactement à vos besoins, pour finalement réaliser qu’il n’existe tout simplement pas sur le marché ?

Je me souviens encore de ce moment précis où, après avoir testé plus de vingt solutions SaaS différentes, j’ai compris que l’infrastructure d’instrumentation que je cherchais devait être créée de toutes pièces. C’était il y a quelques années, et cette frustration m’a conduit à découvrir un univers fascinant : celui des outils sur mesure propulsés par l’ intelligence artificielle . Aujourd’hui, grâce aux avancées des agents IA et des technologies no-code, créer son propre micro-SaaS n’est plus réservé aux géants de la tech. Que vous soyez entrepreneur, responsable d’équipe ou dirigeant d’entreprise, vous pouvez désormais concrétiser vos idées et développer des solutions parfaitement adaptées à votre activité.

Dans cet article complet, je vais vous partager mon expérience, mes réussites mais aussi mes échecs dans la création d’une infrastructure d’instrumentation performante. Vous découvrirez comment transformer votre rêve d’avoir exactement l’outil dont vous avez besoin en réalité concrète. Je vous guiderai pas à pas à travers les concepts fondamentaux, les outils recommandés, les cas d’usage concrets et les stratégies qui fonctionnent vraiment. Préparez-vous à découvrir comment l’ IA et les intelligences artificielles peuvent révolutionner votre manière de travailler et vous donner un avantage compétitif décisif.

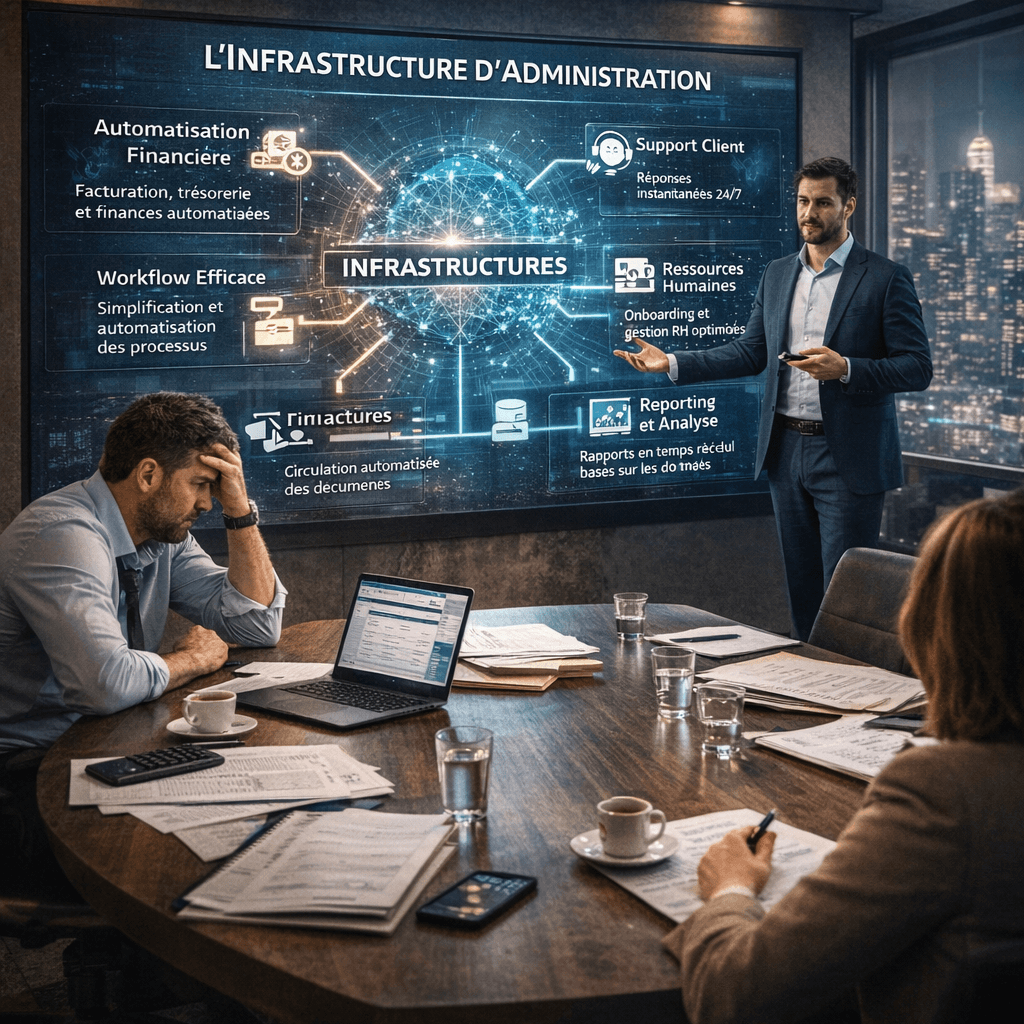

1. Comprendre l’Infrastructure d’Instrumentation : La Base de Votre Transformation Digitale

Lorsque j’ai commencé à m’intéresser à l’ infrastructure d’instrumentation , j’avoue que le terme me semblait intimidant et réservé aux experts techniques. Pourtant, au fil de mes expériences, j’ai réalisé qu’il s’agissait simplement de l’ensemble des outils, systèmes et processus qui permettent de mesurer, surveiller et optimiser les performances de vos activités. C’est le système nerveux de votre entreprise digitale.

Imaginez que vous dirigez une petite entreprise de commerce électronique. Vous utilisez probablement un CRM pour gérer vos clients, un outil d’emailing pour vos campagnes marketing, une plateforme de gestion de stocks, et peut-être un logiciel de comptabilité. Tous ces outils fonctionnent en silos, et vous passez des heures chaque semaine à copier-coller des données d’un système à l’autre. C’est exactement le problème que l’ infrastructure d’instrumentation vise à résoudre.

Contrairement aux solutions toutes faites du marché, une infrastructure d’instrumentation sur mesure s’adapte parfaitement à vos processus métier uniques. Elle connecte vos différents outils, automatise les tâches répétitives et vous donne une vision globale de votre activité en temps réel. Grâce aux agents IA , cette infrastructure peut même apprendre de vos habitudes et s’améliorer continuellement.

Ce qui rend cette approche encore plus puissante aujourd’hui, c’est l’accessibilité des technologies no-code et low-code. Vous n’avez plus besoin d’une équipe de développeurs pour créer votre propre micro-SaaS. Des plateformes comme Bubble, Softr ou Glide vous permettent de construire des applications complexes avec une simple interface visuelle. J’ai moi-même créé mon premier outil de gestion de projets sur mesure en seulement deux semaines, sans écrire une seule ligne de code.

L’ intelligence artificielle joue un rôle central dans cette révolution. Les agents IA peuvent analyser vos données, identifier des tendances, automatiser des décisions et même interagir avec vos clients. Ils transforment votre infrastructure statique en un système vivant et intelligent qui évolue avec vos besoins.

a. Les Trois Piliers d’une Infrastructure d’Instrumentation Efficace

Au cours de mes différents projets, j’ai identifié trois piliers essentiels qui déterminent le succès d’une infrastructure d’instrumentation :

Premièrement, la collecte de données . Votre infrastructure doit être capable de capturer toutes les informations pertinentes de vos différentes sources : interactions clients, performances de vos campagnes marketing, données de ventes, feedbacks utilisateurs, etc. Sans données de qualité, même les meilleurs agents IA ne pourront pas vous aider. J’ai appris cette leçon à mes dépens lors de mon premier projet, où j’avais négligé l’importance d’une collecte structurée des données. Résultat : des mois de travail perdus à nettoyer et réorganiser les informations.

Deuxièmement, l’automatisation intelligente . C’est ici que les intelligences artificielles entrent en jeu. Votre infrastructure doit non seulement collecter les données, mais aussi les traiter automatiquement et déclencher des actions sans intervention humaine. Par exemple, un agent IA peut analyser les comportements d’achat de vos clients et envoyer automatiquement des recommandations personnalisées au bon moment. Cette automatisation libère un temps précieux que vous pouvez consacrer à des tâches à plus forte valeur ajoutée.

Troisièmement, la visualisation et l’analyse . Les données n’ont de valeur que si vous pouvez les comprendre facilement. Votre infrastructure doit inclure des dashboards clairs qui vous montrent en un coup d’œil l’état de votre activité. J’utilise personnellement des tableaux de bord créés sur mesure qui me permettent de suivre mes KPI principaux sans me noyer dans les détails techniques.

b. Pourquoi les Solutions Standards Ne Suffisent Plus

J’ai longtemps cru qu’en combinant plusieurs outils SaaS populaires, je pourrais couvrir tous mes besoins. Mailchimp pour l’emailing, Salesforce pour le CRM, Google Analytics pour les statistiques web, Trello pour la gestion de projets… La liste s’allongeait sans cesse. Le problème ? Ces outils ne communiquent pas naturellement entre eux, et surtout, ils n’ont pas été conçus spécifiquement pour votre manière unique de travailler.

Les solutions standards sont créées pour répondre aux besoins du plus grand nombre. Elles proposent des fonctionnalités génériques qui conviennent à 80% des utilisateurs, mais laissent chacun frustré sur les 20% restants qui correspondent précisément à ses spécificités. C’est comme acheter un costume en prêt-à-porter plutôt que sur mesure : ça fonctionne, mais ce n’est jamais parfaitement ajusté.

Avec une infrastructure d’instrumentation sur mesure propulsée par l’ IA , vous créez exactement ce dont vous avez besoin. Vous définissez vos propres règles métier, vos propres workflows, vos propres indicateurs de performance. Les agents IA s’adaptent à votre vocabulaire, à vos processus, à votre culture d’entreprise. C’est cette personnalisation extrême qui fait toute la différence.

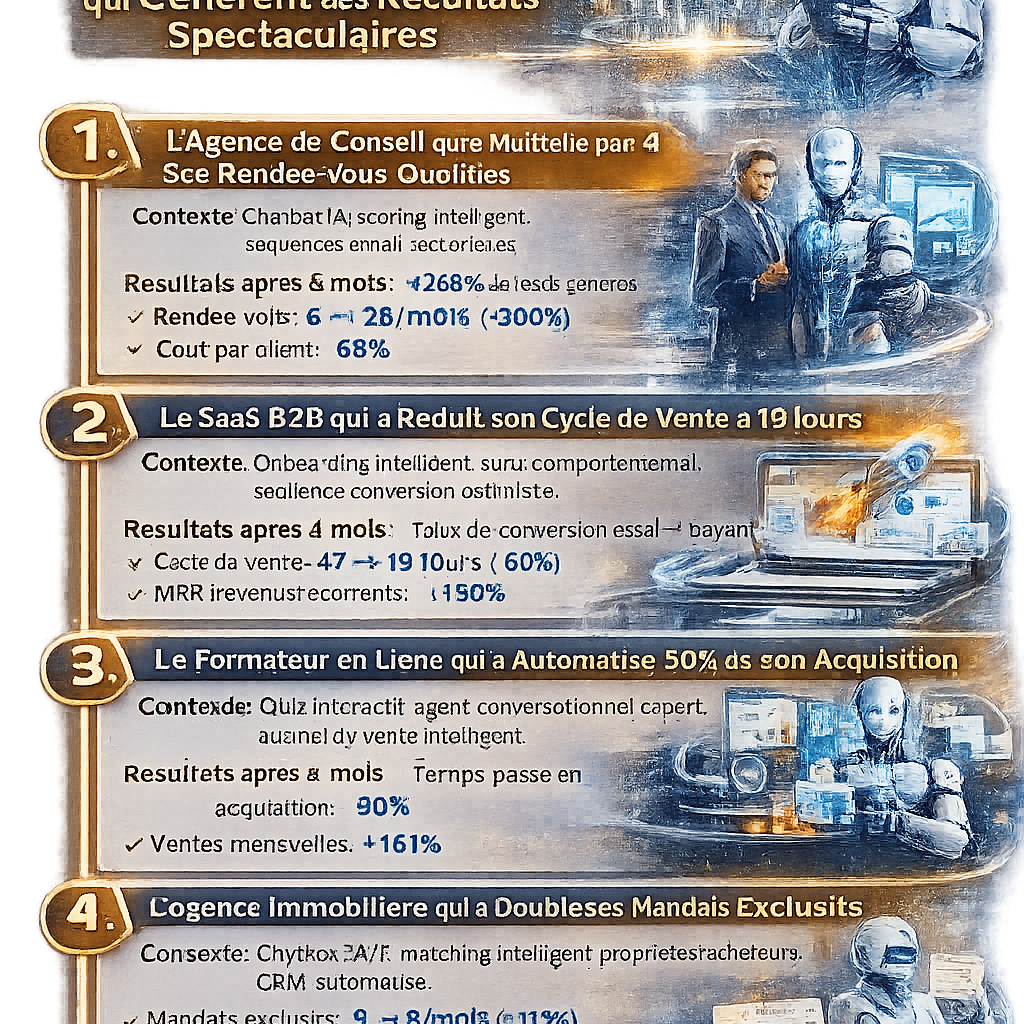

Je me souviens d’un client qui gérait une entreprise de services B2B. Son processus de qualification des leads était très spécifique, avec des critères uniques à son industrie. Aucun CRM standard ne proposait cette logique de qualification. Nous avons créé ensemble un micro-SaaS qui automatisait entièrement son processus, en utilisant un agent IA pour analyser les interactions avec les prospects et les scorer automatiquement. En trois mois, son taux de conversion a augmenté de 40%.

2. Les Outils sur Mesure et Micro-SaaS : Votre Avantage Compétitif Caché

Pendant des années, créer un logiciel sur mesure était synonyme de budgets astronomiques et de projets qui s’éternisaient. Je me rappelle avoir consulté une agence de développement pour un projet relativement simple : ils m’avaient annoncé un devis de 80 000 euros et un délai de huit mois. C’était tout simplement hors de portée pour mon entreprise à l’époque.

Aujourd’hui, le paysage a radicalement changé. Les outils no-code et low-code, combinés aux capacités des agents IA , ont démocratisé la création de logiciels personnalisés. Vous pouvez désormais développer votre propre micro-SaaS avec des budgets et des délais 10 fois inférieurs à ce qu’ils étaient il y a seulement cinq ans.

Un micro-SaaS, c’est essentiellement une petite application logicielle qui résout un problème très spécifique pour une niche particulière. Contrairement aux gros SaaS qui tentent de tout faire, un micro-SaaS excelle dans un domaine précis. C’est comme avoir un couteau suisse versus un couteau de chef professionnel : le premier fait beaucoup de choses correctement, le second fait une chose exceptionnellement bien.

L’avantage majeur des outils sur mesure dans le contexte d’une infrastructure d’instrumentation , c’est qu’ils s’intègrent parfaitement dans votre écosystème existant. Ils parlent le même langage que vos autres systèmes, partagent les mêmes données et respectent vos processus métier. Les intelligences artificielles peuvent facilement apprendre de ces interactions pour optimiser continuellement les performances.

a. Mon Premier Micro-SaaS : Leçons d’une Aventure Entrepreneuriale

Je vais vous raconter une histoire personnelle qui illustre parfaitement la puissance des outils sur mesure. Il y a trois ans, je gérais une petite équipe de consultants qui intervenaient chez différents clients. Notre problème majeur était la gestion des plannings et la facturation : chaque consultant avait des tarifs différents selon les clients, des frais de déplacement variables, et nous devions produire des rapports détaillés pour chaque mission.

J’ai d’abord essayé des dizaines d’outils de gestion existants. Certains géraient bien les plannings mais pas la facturation. D’autres proposaient une facturation complexe mais ne s’adaptaient pas à notre modèle de tarification. Aucun ne correspondait vraiment à nos besoins.

C’est alors que j’ai décidé de créer mon propre outil. Sans aucune compétence en programmation traditionnelle, j’ai utilisé Bubble pour construire une application web personnalisée. J’ai intégré Airtable comme base de données pour stocker les informations sur les clients, les consultants et les missions. Puis j’ai connecté Make (anciennement Integromat) pour automatiser la génération des factures et l’envoi des rappels de paiement.

La partie la plus innovante de mon système était l’utilisation d’un agent IA pour optimiser automatiquement les plannings. L’ intelligence artificielle analysait les préférences de chaque consultant, les contraintes géographiques, les compétences requises pour chaque mission, et proposait des plannings optimisés qui maximisaient notre rentabilité tout en respectant l’équilibre vie professionnelle-vie personnelle de l’équipe.

Le développement m’a pris environ six semaines, en travaillant quelques heures par jour. Le coût total ? Moins de 500 euros en abonnements aux différentes plateformes. Et les résultats ont dépassé toutes mes espérances : nous avons réduit de 70% le temps passé sur la gestion administrative, augmenté notre taux de facturation de 25%, et amélioré significativement la satisfaction de l’équipe.

Cette expérience m’a ouvert les yeux sur les possibilités infinies offertes par les outils sur mesure. Depuis, j’ai créé plusieurs autres micro-SaaS pour différents besoins, et j’aide régulièrement des clients à concrétiser leurs propres projets.

b. Identifier les Opportunités de Création d’Outils sur Mesure

La question que tout le monde se pose est : comment savoir si vous avez besoin d’un outil sur mesure plutôt que d’une solution existante ? Au fil de mes projets, j’ai développé une méthode simple pour identifier les opportunités.

Premier signal d’alerte : vous passez plus de deux heures par semaine à copier-coller des données entre différents outils . C’est le signe évident que vos systèmes ne communiquent pas correctement entre eux. Un outil sur mesure avec une infrastructure d’instrumentation bien conçue peut automatiser entièrement ces transferts de données.

Deuxième indicateur : vous devez adapter vos processus métier aux limitations de vos outils . Si vous vous surprenez à dire « On doit faire comme ça parce que le logiciel ne permet pas autre chose », c’est que l’outil contrôle votre manière de travailler au lieu de la servir. Un micro-SaaS personnalisé s’adapte à vos processus, pas l’inverse.

Troisième signe : vous payez pour des fonctionnalités que vous n’utilisez jamais . Les gros SaaS proposent des centaines de fonctionnalités dont vous n’avez besoin que d’une fraction. Créer votre propre outil vous permet de ne payer que pour ce que vous utilisez réellement, tout en ayant exactement ce dont vous avez besoin.

Quatrième révélateur : vos équipes se plaignent régulièrement de la complexité de vos outils . Si la formation à vos systèmes prend des semaines et que même vos employés expérimentés ont du mal à les utiliser efficacement, c’est qu’ils ne sont pas adaptés. Un outil conçu spécifiquement pour votre équipe sera naturellement plus intuitif.

Cinquième et dernier signal : vous avez une idée précise de ce qui améliorerait drastiquement votre productivité, mais ça n’existe pas sur le marché . C’est exactement la situation où les outils sur mesure brillent. Les agents IA peuvent même vous aider à affiner cette vision et à identifier les fonctionnalités qui apporteront le plus de valeur.

Je vais continuer avec les sections suivantes…

3. Les Objectifs Stratégiques d’une Infrastructure d’Instrumentation Moderne

Quand j’ai commencé à développer ma première infrastructure d’instrumentation , je me suis rapidement rendu compte qu’il ne suffisait pas d’avoir des outils qui fonctionnent. Il fallait que ces outils servent des objectifs stratégiques clairs et mesurables. Sans vision stratégique, vous risquez de créer des systèmes complexes qui ne génèrent pas de valeur réelle pour votre entreprise.

Laissez-moi vous partager les trois objectifs fondamentaux que j’ai identifiés comme essentiels pour toute infrastructure d’instrumentation réussie, et comment l’ intelligence artificielle transforme radicalement notre capacité à les atteindre.

Créer des outils parfaits pour votre activité spécifique . C’est l’objectif premier et le plus évident. Chaque entreprise a ses particularités, ses processus uniques, sa culture propre. Un outil parfait n’est pas celui qui fait le plus de choses, mais celui qui fait exactement ce dont vous avez besoin, de la manière dont vous en avez besoin. Les agents IA peuvent analyser vos patterns d’utilisation et suggérer des améliorations continues pour que votre outil reste toujours parfaitement aligné avec vos besoins évolutifs.

Je me souviens d’un projet pour une entreprise de logistique qui avait des besoins très spécifiques en matière de suivi des livraisons. Aucun logiciel du marché ne gérait leurs particularités : livraisons multi-étapes avec validation à chaque point, calcul de pénalités selon des règles complexes, intégration avec des systèmes legacy vieux de vingt ans. Nous avons créé un micro-SaaS qui non seulement répondait à ces besoins, mais utilisait aussi un agent IA pour prédire les retards potentiels et proposer des solutions alternatives en temps réel. Leur taux de livraisons dans les délais est passé de 78% à 96% en six mois.

Adapter la technologie à vos besoins spécifiques plutôt que l’inverse . C’est peut-être l’aspect le plus libérateur de l’approche sur mesure. Pendant des années, nous avons été conditionnés à penser que nous devions adapter nos processus aux outils disponibles. « C’est comme ça que ça marche dans Salesforce », « Excel ne permet pas de faire ça », « Il faudra former l’équipe à la logique de cet outil ». Ces phrases, je les ai entendues des centaines de fois, et elles révèlent un problème fondamental : la technologie dicte votre manière de travailler.

Avec une infrastructure d’instrumentation sur mesure, vous inversez cette dynamique. Vous définissez d’abord comment vous voulez travailler de manière optimale, puis vous créez la technologie qui supporte cette vision. Les intelligences artificielles rendent cela encore plus puissant en permettant à vos outils d’apprendre et de s’adapter continuellement à vos évolutions.

J’ai travaillé avec une agence de communication qui avait un processus créatif très particulier, avec des allers-retours clients structurés selon leur propre méthodologie éprouvée. Ils avaient essayé tous les outils de gestion de projets créatifs du marché, mais aucun ne respectait leur processus. Résultat : soit ils adaptaient leur méthode (et perdaient en efficacité), soit ils utilisaient des dizaines de fichiers Excel et Google Sheets disséminés partout. Nous avons construit un système qui modélisait exactement leur processus, avec un agent IA qui suggérait automatiquement les prochaines étapes et alertait sur les risques de dérive. Leur temps de production par projet a diminué de 30%.

Construire des solutions que le marché ne propose pas . C’est l’objectif le plus ambitieux et celui qui offre le plus grand avantage compétitif. Il existe des milliers de SaaS sur le marché, mais il y a toujours des besoins spécifiques, des niches inexploitées, des processus uniques que personne n’a encore adressés. C’est là que réside votre opportunité.

L’ IA joue un rôle crucial dans cette quête de l’innovation. Les agents IA peuvent analyser votre secteur d’activité, identifier les inefficacités que vos concurrents n’ont pas encore résolues, et vous aider à concevoir des solutions vraiment différenciantes. Ils peuvent aussi apprendre de vos données propriétaires pour créer des capacités que personne d’autre ne peut répliquer facilement.

a. Comment Définir Vos Objectifs Stratégiques : Ma Méthode en 5 Étapes

Après avoir accompagné des dizaines d’entreprises dans la création de leur infrastructure d’instrumentation , j’ai développé une méthode en cinq étapes pour définir des objectifs stratégiques clairs et actionnables.

Étape 1 : L’audit brutal de vos processus actuels . Prenez une semaine pour documenter honnêtement comment vous travaillez vraiment, pas comment vous pensez travailler ou comment vous aimeriez travailler. Chronométrez le temps passé sur chaque tâche. Identifiez les frictions, les frustrations, les goulots d’étranglement. J’utilise un simple fichier où je note chaque fois que je me dis « Ce serait tellement plus simple si… ». À la fin de la semaine, vous avez une liste précieuse d’opportunités d’amélioration.

Étape 2 : Priorisez selon l’impact et la faisabilité . Toutes les améliorations ne se valent pas. Créez une matrice à deux axes : impact potentiel sur votre activité (économie de temps, augmentation de revenus, amélioration de qualité) et faisabilité technique. Les meilleurs projets sont ceux qui combinent fort impact et faisabilité raisonnable. C’est là que les agents IA peuvent vraiment vous aider en analysant vos données pour quantifier l’impact réel de chaque amélioration potentielle.

Étape 3 : Définissez des KPI mesurables . « Améliorer la productivité » n’est pas un objectif, c’est un vœu pieux. « Réduire de 50% le temps passé sur la saisie de données d’ici 3 mois » est un objectif SMART. Pour chaque projet d’ infrastructure d’instrumentation , je définis toujours 3 à 5 KPI principaux que je vais suivre religieusement. Sans mesure, impossible de savoir si vous progressez.

Étape 4 : Commencez petit et itérez . L’erreur classique est de vouloir créer immédiatement le système parfait et complet. J’ai commis cette erreur plusieurs fois, et ça m’a coûté cher en temps et en frustration. Aujourd’hui, je commence toujours par un MVP (Minimum Viable Product) qui résout le problème le plus urgent. Une fois qu’il fonctionne et génère de la valeur, j’ajoute progressivement des fonctionnalités. Cette approche itérative est parfaitement adaptée aux outils no-code et aux intelligences artificielles qui apprennent et s’améliorent avec le temps.

Étape 5 : Impliquez vos équipes dès le départ . Un outil n’a de valeur que s’il est utilisé. J’ai appris qu’impliquer les utilisateurs finaux dès la conception garantit non seulement une meilleure adoption, mais génère aussi des idées auxquelles vous n’auriez jamais pensé seul. Organisez des sessions de co-création où vos équipes peuvent exprimer leurs besoins et tester les premières versions. Les agents IA peuvent analyser ces feedbacks et suggérer des améliorations continues basées sur les patterns d’utilisation réels.

b. Les Erreurs Stratégiques à Éviter Absolument

Permettez-moi de vous partager les erreurs que j’ai commises ou que j’ai vu commettre trop souvent, pour que vous puissiez les éviter. Croyez-moi, chacune de ces erreurs peut coûter des mois de travail et des milliers d’euros.

Erreur n°1 : Copier ce qui existe déjà . Si votre objectif est simplement de recréer Salesforce ou Asana avec un autre nom, vous perdez votre temps. L’intérêt des outils sur mesure est justement de faire ce que les solutions existantes ne font pas. Trop de projets échouent parce qu’ils essaient de reproduire des fonctionnalités standard au lieu de se concentrer sur leur valeur ajoutée unique.

Erreur n°2 : Sous-estimer l’importance de l’expérience utilisateur . Ce n’est pas parce que votre outil est sur mesure qu’il peut être moche et difficile à utiliser. Au contraire, il doit être encore plus intuitif puisqu’il est censé s’adapter parfaitement à vos utilisateurs. J’ai vu des projets techniquement excellents abandonner par les équipes simplement parce que l’interface était rebutante. Investissez du temps dans le design et l’ergonomie, même sur un MVP.

Erreur n°3 : Négliger la scalabilité dès le départ . Votre outil sur mesure doit pouvoir grandir avec votre entreprise. J’ai commis cette erreur sur mon premier projet : j’avais construit un système qui fonctionnait parfaitement pour 10 utilisateurs, mais qui s’est écroulé quand nous sommes passés à 50. Pensez scalabilité dès la conception, surtout si vous utilisez des agents IA qui vont traiter des volumes de données croissants.

Erreur n°4 : Ne pas prévoir la maintenance et l’évolution . Un outil n’est jamais « terminé ». Vos besoins vont évoluer, les technologies vont changer, des bugs vont apparaître. Prévoyez dès le départ un budget et du temps pour la maintenance continue. Les plateformes no-code facilitent grandement cette maintenance, mais elle reste nécessaire.

Erreur n°5 : Vouloir tout automatiser immédiatement avec l’IA . L’ intelligence artificielle est puissante, mais elle n’est pas magique. J’ai vu des projets qui voulaient intégrer des agents IA partout sans avoir d’abord solidifié les fondations. Commencez par des processus clairs et des données de qualité, puis ajoutez progressivement les capacités d’ IA là où elles apportent réellement de la valeur.

4. Cas d’Usage Concrets : Quand et Comment Créer Vos Outils sur Mesure

La théorie c’est bien, mais rien ne vaut des exemples concrets pour comprendre vraiment le potentiel d’une infrastructure d’instrumentation personnalisée. Je vais vous partager cinq cas d’usage que j’ai personnellement mis en œuvre ou accompagnés, avec les résultats obtenus et les leçons apprises. Ces exemples couvrent différents secteurs et différents niveaux de complexité, pour que vous puissiez vous identifier quelle que soit votre situation.

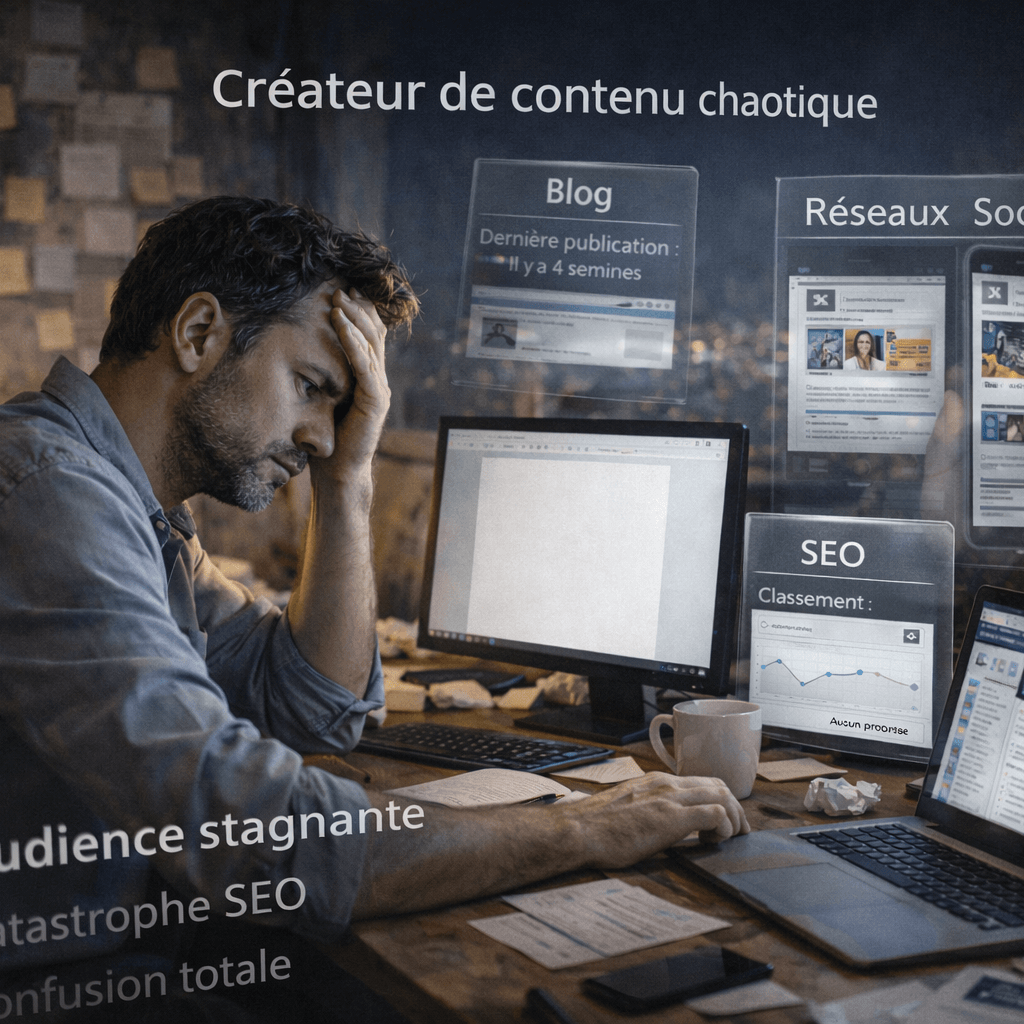

a. Cas d’Usage #1 : Développement d’un Micro-SaaS Spécifique pour la Gestion de Contenu

Il y a deux ans, j’ai travaillé avec une agence de content marketing qui produisait des centaines d’articles par mois pour différents clients. Leur problème ? Un processus de production chaotique où les briefings se perdaient, les validations traînaient, et personne n’avait une vue d’ensemble de l’avancement des projets.

Ils utilisaient une combinaison de Trello, Google Docs, Gmail et des feuilles Excel. Chaque chef de projet avait sa propre manière d’organiser les choses, ce qui rendait impossible toute standardisation ou optimisation. Quand un client demandait « Où en est mon article sur le SEO? », il fallait parfois une heure pour retrouver l’information.

Nous avons créé ensemble un micro-SaaS baptisé « ContentFlow » qui centralisait tout le processus de production de contenu. Voici ce que nous avons mis en place en utilisant une combinaison de Bubble pour l’interface, Airtable pour la base de données et Make pour les automatisations :

Un système de briefing structuré où les commerciaux pouvaient créer des demandes clients avec tous les détails nécessaires (mot-clé cible, angle éditorial, ton, longueur, deadline, etc.). Plus besoin de chercher dans des emails interminables.

Un workflow automatisé qui assignait automatiquement les articles aux rédacteurs disponibles selon leurs spécialités et leur charge de travail actuelle. C’est là que nous avons intégré notre premier agent IA : il analysait le sujet de l’article et le profil de chaque rédacteur pour proposer le meilleur matching possible.

Un système de validation multi-niveaux avec relances automatiques. Dès qu’un rédacteur soumettait un article, le chef de projet recevait une notification. S’il ne validait pas sous 48h, un rappel automatique était envoyé. Même chose pour les validations clients.

Un dashboard global où le directeur de l’agence pouvait voir en temps réel tous les projets en cours, identifier les goulots d’étranglement, et anticiper les problèmes de capacité.

Le plus innovant était l’intégration d’un agent IA pour l’analyse qualité. Avant qu’un article ne soit soumis au client, l’ intelligence artificielle vérifiait automatiquement plusieurs critères : respect du nombre de mots, présence des mots-clés cibles, lisibilité, originalité du contenu. Elle générait un score qualité et des recommandations d’amélioration. Cela a considérablement réduit les allers-retours avec les clients.

Les résultats après six mois d’utilisation ont dépassé toutes les attentes :

- Réduction de 60% du temps passé sur la gestion administrative

- Augmentation de 40% de la capacité de production sans recrutement supplémentaire

- Taux de satisfaction client passé de 72% à 94%

- Délais de livraison moyens réduits de 14 à 8 jours

Le coût total de développement ? Environ 3 000 euros et un mois de travail. Comparé aux dizaines de milliers d’euros qu’ils auraient dépensés pour un développement traditionnel, c’était une révolution.

b. Cas d’Usage #2 : Intégrations Custom Entre Outils Existants

Parfois, vous n’avez pas besoin de créer un outil complet de zéro. Votre besoin est simplement de faire communiquer intelligemment vos outils existants. C’est exactement le cas d’une entreprise de e-commerce avec laquelle j’ai collaboré récemment.

Ils utilisaient Shopify pour leur boutique en ligne, Mailchimp pour l’email marketing, un CRM custom qu’ils avaient développé des années auparavant, et QuickBooks pour la comptabilité. Le problème ? Chaque système vivait dans son propre monde. Quand un client passait une commande sur Shopify, il fallait manuellement :

- Créer ou mettre à jour la fiche client dans le CRM

- L’ajouter à la bonne liste de segmentation dans Mailchimp

- Générer la facture dans QuickBooks

Mettre à jour les stocks dans différents entrepôts

Déclencher le processus d’expédition

Cette gymnastique quotidienne prenait facilement trois heures par jour à une personne dédiée. Pire encore, les erreurs de saisie manuelle créaient régulièrement des incohérences entre les systèmes, causant des problèmes de service client et des écarts comptables.

Nous avons construit une infrastructure d’instrumentation qui connectait intelligemment tous ces systèmes grâce à Make (anciennement Integromat) et quelques scripts personnalisés. Voici comment nous avons procédé :

Première étape : mapper tous les flux de données . J’ai passé deux jours à observer et documenter chaque action manuelle, chaque transfert d’information entre systèmes. Ce travail préparatoire est crucial mais souvent négligé. Sans cette cartographie précise, vous risquez de créer des automatisations qui ne reflètent pas la réalité de vos processus.

Deuxième étape : créer des connecteurs intelligents . Nous avons utilisé les APIs de chaque plateforme pour créer des ponts automatiques. Par exemple, dès qu’une commande était validée sur Shopify, un scénario Make se déclenchait automatiquement pour :

Extraire toutes les informations du client et de la commande

Vérifier si le client existe déjà dans le CRM (via une recherche par email)

Si oui, mettre à jour sa fiche avec les nouvelles informations de commande

Si non, créer une nouvelle fiche complète

Ajouter automatiquement le client au segment approprié dans Mailchimp basé sur ses achats

Générer la facture dans QuickBooks avec tous les détails fiscaux corrects

Déclencher le workflow d’expédition

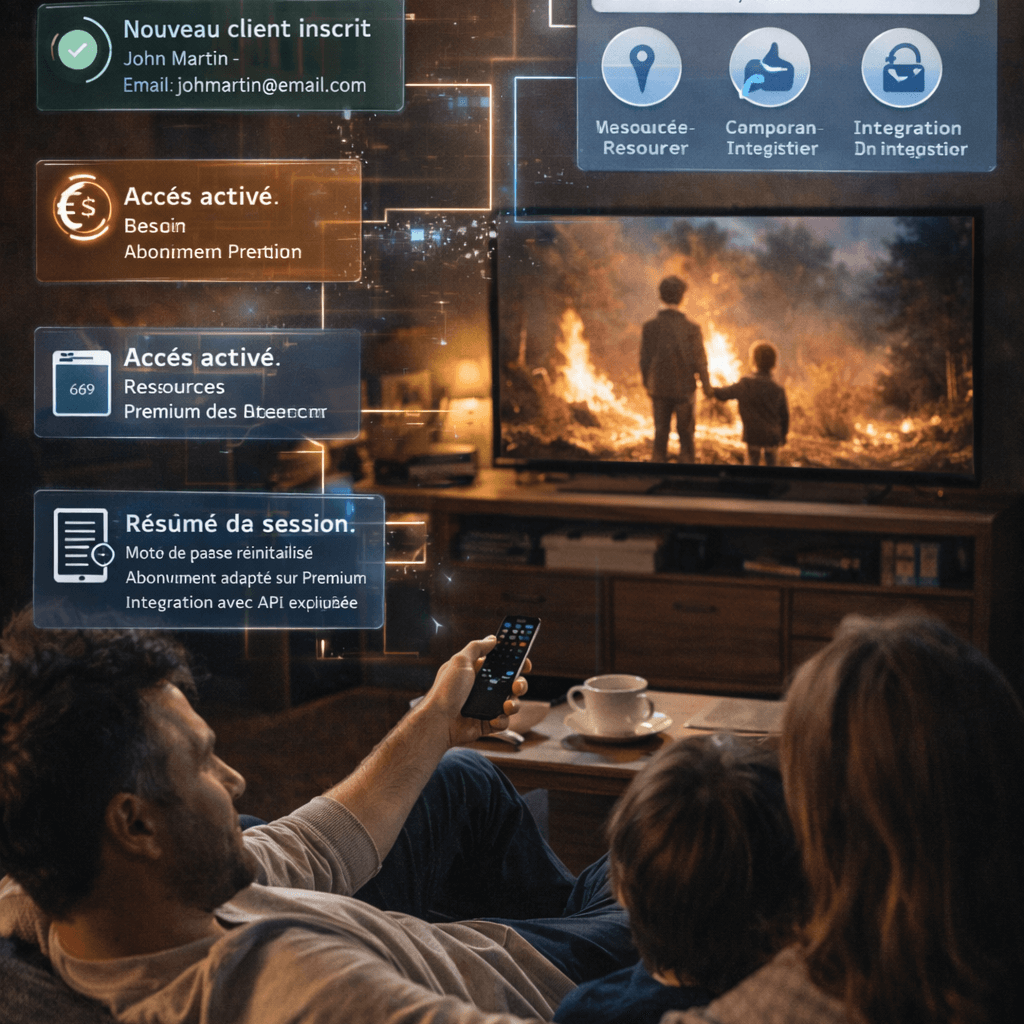

Troisième étape : intégrer un agent IA pour la gestion intelligente . C’est là que notre solution est devenue vraiment puissante. Nous avons intégré un agent IA qui analysait chaque commande pour :

Détecter les clients à fort potentiel (basé sur la valeur panier, fréquence d’achat, type de produits)

Identifier les risques de fraude en analysant des patterns suspects

Suggérer des produits complémentaires que l’équipe commerciale pouvait proposer

Prédire la probabilité de retour produit et ajuster la communication en conséquence

L’ intelligence artificielle apprenait continuellement des données historiques pour affiner ses prédictions. Après six mois, elle avait identifié des patterns que même les employés les plus expérimentés n’avaient pas remarqués.

Quatrième étape : créer des dashboards unifiés . Nous avons développé des tableaux de bord personnalisés qui agrégaient les données de tous les systèmes. Le directeur commercial pouvait enfin voir en un coup d’œil les ventes du jour, les clients VIP, les alertes de stock faible, et les opportunités détectées par l’ agent IA .

Les résultats ont été spectaculaires :

Élimination totale des trois heures quotidiennes de saisie manuelle

Réduction de 95% des erreurs de données entre systèmes

Augmentation de 28% du panier moyen grâce aux recommandations IA

Taux de détection de fraude amélioré de 40%

ROI atteint en moins de trois mois

Le coût du projet ? Environ 5 000 euros pour le développement initial et 200 euros par mois pour les abonnements aux différentes plateformes. Comparé au coût d’un employé à temps plein, c’était une évidence économique.

c. Cas d’Usage #3 : Dashboards et Rapports sur Mesure pour la Prise de Décision

Les données sont partout dans nos entreprises, mais trop souvent, elles restent enfermées dans des silos inaccessibles ou présentées de manière incompréhensible. J’ai vécu cette frustration avec un client du secteur immobilier qui collectait des millions de données sur ses biens, ses clients, ses transactions, mais n’arrivait pas à en tirer des insights actionnables.

Ils avaient essayé Google Data Studio, Tableau, Power BI… Chaque outil était puissant, mais aucun ne répondait exactement à leurs questions métier spécifiques. Leurs agents immobiliers passaient plus de temps à créer des rapports Excel qu’à vendre des propriétés.

Nous avons créé ensemble un système de dashboards sur mesure qui transformait leurs données brutes en intelligence d’affaires. La solution combinait plusieurs technologies :

Airtable comme base de données centrale : nous avons migré toutes leurs données disparates (fichiers Excel, Google Sheets, anciennes bases Access) dans une structure Airtable propre et cohérente. Ce travail de nettoyage et standardisation a pris du temps, mais c’était la fondation indispensable.

Softr pour créer des interfaces personnalisées : chaque type d’utilisateur (agent immobilier, directeur d’agence, responsable marketing, direction générale) avait son propre portail avec exactement les informations pertinentes pour son rôle. Plus besoin de chercher dans des tableaux complexes, chacun voyait immédiatement ses KPI principaux.

Make pour les calculs automatiques complexes : l’ infrastructure d’instrumentation calculait automatiquement des métriques personnalisées comme le « score d’attractivité » d’un bien (combinant emplacement, prix au m², état, demande locale), le « potentiel de conversion » d’un prospect, ou le « risque de perte » d’une transaction en cours.

Un agent IA pour les insights prédictifs : c’est la partie la plus innovante. L’ agent IA analysait les données historiques pour prédire :

Le prix optimal de vente d’un bien selon les caractéristiques et le marché

La probabilité de conclure une vente selon le comportement du prospect

Les meilleures périodes pour lister certains types de biens

Les quartiers en développement où investir avant la concurrence

Ce qui rendait ce système vraiment puissant, c’était son caractère évolutif. Contrairement aux outils standard où vous êtes limité aux métriques prédéfinies, ici nous pouvions ajouter de nouveaux indicateurs en quelques heures selon les besoins émergents. Quand ils ont lancé une nouvelle offre de location meublée, nous avons créé un dashboard dédié en deux jours.

Les dashboards comprenaient également des alertes intelligentes. Par exemple :

Notification automatique quand un bien restait trop longtemps sur le marché (avec suggestions IA pour ajuster le prix ou la stratégie marketing)

Alerte quand un prospect à fort potentiel montrait des signes de désintérêt

Détection des agents en sous-performance avec recommandations de formation

Identification des opportunités de marché inexploitées

Les résultats après un an d’utilisation :

Temps de création de rapports réduit de 12 heures à 15 minutes par semaine

Taux de conversion prospects-ventes augmenté de 22%

Délai moyen de vente réduit de 87 à 64 jours

Marge bénéficiaire améliorée de 15% grâce au pricing optimisé par l’IA

Satisfaction agents passée de 68% à 91%

Ce projet m’a appris une leçon importante : les intelligences artificielles sont d’autant plus puissantes qu’elles sont appliquées à des données propres et structurées. Sans le travail préparatoire de nettoyage et organisation, même le meilleur agent IA ne peut pas faire de miracles.

d. Cas d’Usage #4 : Workflows Complexes avec Logique Métier Spécifique

Certains processus métier sont tellement spécifiques et complexes qu’aucun outil standard ne peut les gérer. J’ai rencontré cette situation avec une entreprise de services B2B qui avait un processus de qualification et onboarding client extrêmement élaboré, fruit de quinze ans d’expérience et d’optimisations.

Leur processus comprenait 47 étapes différentes, avec des branches conditionnelles selon le type de client, la taille du contrat, le secteur d’activité, et même la personnalité du décideur. Ils essayaient de gérer tout ça avec une combinaison chaotique de Salesforce (pour le CRM), Asana (pour le suivi des tâches), Google Forms (pour les questionnaires), et un tableau Excel partagé de 200 lignes qui était leur « source de vérité ».

Le problème ? Les nouveaux employés mettaient trois mois à maîtriser le processus. Des étapes étaient régulièrement oubliées. Les clients recevaient parfois la mauvaise information au mauvais moment. Et surtout, impossible d’optimiser ou améliorer ce qui n’était pas clairement visible et mesuré.

Nous avons créé un système sur mesure qui automatisait et orchestrait intelligemment ce workflow complexe. Voici l’approche que nous avons suivie :

Phase 1 : Modélisation exhaustive du processus . J’ai passé deux semaines avec leurs meilleurs account managers pour documenter chaque étape, chaque décision, chaque exception. Nous avons créé des flowcharts détaillés qui visualisaient tous les chemins possibles. Ce travail de documentation était précieux en soi, car même les dirigeants n’avaient jamais eu une vue aussi claire de leur propre processus.

Phase 2 : Création d’un moteur de workflow personnalisé . Nous avons utilisé n8n (une alternative open-source à Make) pour créer un système qui orchestrait automatiquement chaque étape. Le système savait exactement quoi faire selon le profil du client :

Quels documents envoyer et dans quel ordre

Quelles questions poser selon les réponses précédentes

Qui assigner à chaque tâche selon les compétences et disponibilités

Quand relancer si une étape bloquait

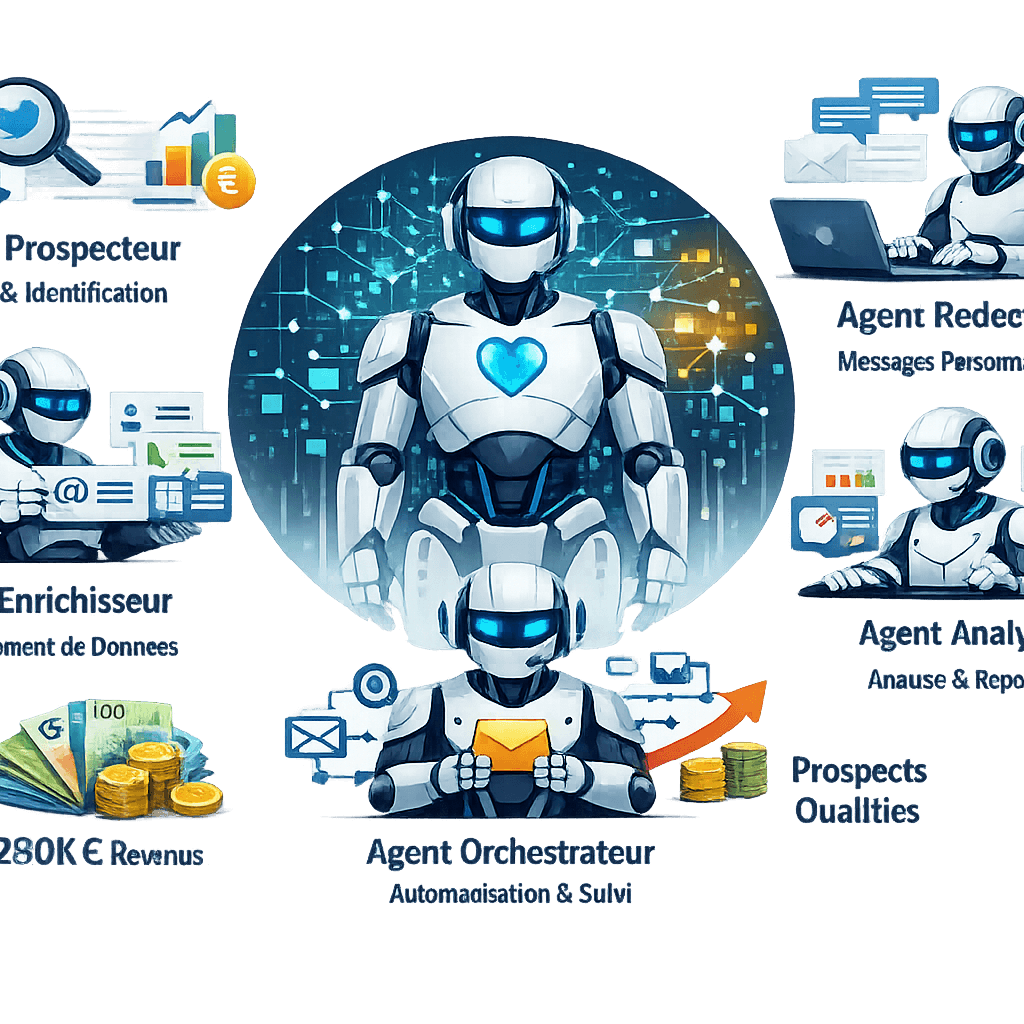

Phase 3 : Intelligence artificielle pour personnalisation et optimisation . Nous avons intégré plusieurs agents IA avec des rôles différents :

Un agent IA de qualification qui analysait les premières interactions avec un prospect pour prédire son potentiel et personnaliser automatiquement le parcours d’onboarding. Par exemple, un grand compte stratégique recevait un parcours VIP avec davantage de touchpoints humains, tandis qu’un petit compte suivait un parcours plus automatisé mais tout aussi efficace.

Un agent IA de détection des risques qui surveillait les signaux faibles de désengagement : délai de réponse qui s’allonge, ton des emails qui change, questions qui révèlent des doutes. Quand l’ intelligence artificielle détectait un risque, elle alertait immédiatement l’account manager avec des recommandations d’actions correctives.

Un agent IA d’optimisation continue qui analysait les parcours réussis versus ceux qui avaient échoué pour suggérer des améliorations. Après six mois, il avait identifié que l’envoi d’une vidéo de présentation personnalisée à l’étape 12 augmentait de 34% le taux de conversion final. Cette insight n’aurait jamais émergé sans l’analyse IA.

Phase 4 : Interface utilisateur intuitive . Malgré la complexité sous-jacente, nous avons créé une interface ultra-simple pour les utilisateurs. Chaque account manager voyait simplement un dashboard avec ses clients en cours, les prochaines actions à réaliser, et des alertes prioritaires. Le système gérait toute la complexité en arrière-plan.

Phase 5 : Intégrations avec l’écosystème existant . Plutôt que de remplacer complètement Salesforce et les autres outils, nous avons créé des synchronisations bidirectionnelles. Les données importantes étaient automatiquement mises à jour partout, éliminant les doubles saisies tout en permettant aux équipes de continuer à utiliser les outils qu’elles connaissaient pour certaines tâches.

Les résultats ont transformé l’entreprise :

Temps d’onboarding client réduit de 6 semaines à 3 semaines

Taux de conversion de prospects qualifiés passé de 47% à 68%

Temps de formation des nouveaux employés réduit de 3 mois à 3 semaines

Satisfaction client (NPS) augmentée de 32 points

Chiffre d’affaires par account manager augmenté de 42%

Ce qui m’a le plus marqué dans ce projet, c’est comment l’ infrastructure d’instrumentation a libéré le potentiel humain. Au lieu de passer leur temps à se rappeler quelle étape venait après, à chercher quel document envoyer, ou à saisir des données, les account managers pouvaient se concentrer sur ce qu’ils font de mieux : construire des relations authentiques avec les clients et apporter de la valeur stratégique.

e. Cas d’Usage #5 : APIs et Connecteurs Personnalisés pour Écosystèmes Complexes

Le dernier cas d’usage que je veux partager concerne les situations où vous devez connecter des systèmes vraiment hétérogènes, parfois anciens, avec des technologies modernes et des agents IA . C’est souvent le cas dans les grandes organisations qui ont accumulé différents systèmes au fil des années.

J’ai travaillé avec une entreprise manufacturière qui utilisait un ERP développé dans les années 90, un système de gestion de production propriétaire, des machines industrielles avec leurs propres interfaces, un CRM moderne, et voulait intégrer des capacités d’ intelligence artificielle pour optimiser la production.

Le défi était énorme : ces systèmes n’étaient pas conçus pour communiquer entre eux. Certains n’avaient même pas d’API. Les formats de données étaient incompatibles. Et pourtant, la direction voulait créer une infrastructure d’instrumentation unifiée qui donnerait une vision en temps réel de toute la chaîne de production, de la commande client jusqu’à la livraison.

Voici comment nous avons résolu ce puzzle complexe :

Pour les systèmes legacy sans API , nous avons créé des connecteurs personnalisés qui extrayaient les données directement des bases de données (après sécurisation appropriée, évidemment). Certains systèmes très anciens nécessitaient même des scripts qui lisaient des fichiers CSV générés périodiquement. Ce n’était pas élégant, mais ça fonctionnait.

Pour les machines industrielles , nous avons utilisé des protocoles IoT (MQTT, OPC-UA) pour capturer les données de production en temps réel : cadence, défauts, arrêts, consommation énergétique. Ces données étaient ensuite centralisées dans une base de données moderne (Supabase dans notre cas).

Pour créer une couche d’intégration unifiée , nous avons développé une API REST personnalisée qui servait de hub central. Tous les systèmes communiquaient avec cette API en utilisant des formats standardisés. C’était comme créer un traducteur universel pour des systèmes qui parlaient des langues différentes.

Pour ajouter l’intelligence artificielle , nous avons connecté des agents IA à cette infrastructure unifiée. Ces intelligences artificielles analysaient les données agrégées pour :

Prédire les pannes machines avant qu’elles ne surviennent (maintenance prédictive)

Optimiser les plannings de production selon les commandes, les capacités et les contraintes

Détecter automatiquement les défauts qualité en analysant les paramètres de production

Suggérer des ajustements de process pour réduire les gaspillages

Ce qui rendait le système vraiment puissant, c’était sa capacité à apprendre continuellement. Par exemple, l’ agent IA de maintenance prédictive analysait les données historiques de pannes, corrélait avec des milliers de paramètres (température, vibrations, âge des pièces, charge de travail…), et affinait constamment ses prédictions. Après un an, il prédisait 87% des pannes avec une avance de 48 à 72 heures.

Nous avons également créé des APIs spécifiques pour différents types d’utilisateurs :

Une API mobile pour les opérateurs de production qui pouvaient signaler des problèmes ou consulter leurs objectifs

Une API web pour les managers qui accédaient aux dashboards

Une API pour les clients qui pouvaient suivre l’avancement de leur commande en temps réel

La partie la plus délicate du projet était la gestion de la sécurité et des droits d’accès. Avec autant de systèmes connectés, nous devions nous assurer que chaque utilisateur n’accédait qu’aux données appropriées. Nous avons implémenté un système d’authentification centralisé avec des rôles granulaires.

Les résultats après 18 mois :

Réduction de 65% des arrêts non planifiés grâce à la maintenance prédictive

Augmentation de 23% de la productivité globale

Réduction de 18% des coûts de maintenance

Délais de livraison clients réduits de 35%

Satisfaction client améliorée de 28 points

Ce projet était techniquement le plus complexe que j’ai jamais réalisé, mais aussi le plus gratifiant. Il prouve que même dans des environnements technologiques très hétérogènes, il est possible de créer une infrastructure d’instrumentation moderne et performante. L’essentiel est d’avoir une vision claire, de procéder par étapes, et de toujours garder le focus sur la valeur métier plutôt que sur la sophistication technique.

5. Les Outils Recommandés pour Construire Votre Infrastructure d’Instrumentation

Après avoir créé des dizaines de projets d’ infrastructure d’instrumentation et testé probablement une centaine d’outils différents, j’ai développé une véritable expertise sur ce qui fonctionne réellement versus ce qui n’est que du marketing. Laissez-moi vous partager mon écosystème d’outils recommandés, organisé par catégorie, avec les avantages et limitations de chacun basés sur mon expérience réelle.

Ce qui est fascinant avec l’écosystème actuel, c’est sa maturité. Il y a cinq ans, les outils no-code étaient limités et bugués. Aujourd’hui, ils rivalisent avec le développement traditionnel pour la majorité des cas d’usage. L’intégration de l’ intelligence artificielle dans ces plateformes les rend encore plus puissantes et accessibles.

a. Outils No-Code : Construire Sans Coder

Les plateformes no-code ont littéralement révolutionné ma manière de travailler. Elles me permettent de transformer une idée en prototype fonctionnel en quelques heures plutôt qu’en plusieurs semaines. Voici mes trois favorites et quand les utiliser :

Bubble : Le couteau suisse des applications web complexes

Bubble est devenu mon outil de prédilection pour créer des applications web sophistiquées. C’est une plateforme extrêmement puissante qui permet de construire pratiquement n’importe quelle application sans écrire de code. J’ai créé avec Bubble des CRM personnalisés, des plateformes de marketplace, des outils de gestion de projets, et même des mini-réseaux sociaux internes pour entreprises.

Ce que j’adore chez Bubble :

La flexibilité totale du design et des fonctionnalités

La possibilité de créer des workflows complexes avec conditions multiples

L’intégration native avec des dizaines d’APIs et services

La communauté massive qui partage des plugins et templates

La possibilité de passer à l’échelle jusqu’à des milliers d’utilisateurs

Les limitations à connaître :

La courbe d’apprentissage est raide, comptez 2-3 semaines pour vraiment maîtriser

Les performances peuvent être moyennes pour des applications très lourdes

Le prix augmente rapidement avec le volume d’utilisation

Certaines fonctionnalités avancées nécessitent quand même du code custom

Mon conseil : Bubble est parfait quand vous avez besoin d’une application complète avec base de données, authentification utilisateurs, et logique métier complexe. C’est un investissement en temps d’apprentissage, mais ça vaut vraiment le coup. J’utilise Bubble pour environ 60% de mes projets de micro-SaaS.

Softr : La solution express pour des interfaces sur Airtable

Softr est l’outil que j’utilise quand je veux créer très rapidement un portail, un site membresé ou un dashboard basé sur des données Airtable. La beauté de Softr est sa simplicité extrême : vous connectez votre base Airtable, choisissez des blocs pré-conçus, customisez le design, et voilà, votre application est prête.

Ce que j’apprécie particulièrement :

La rapidité de développement (je peux créer un portail fonctionnel en 2-3 heures)

L’intégration parfaite avec Airtable, qui est déjà ma base de données favorite

Les templates professionnels qui donnent immédiatement un résultat élégant

Le prix très abordable pour commencer

La gestion native des permissions et droits d’accès

Les limitations :

Vous êtes totalement dépendant d’Airtable comme backend

Les options de customisation sont plus limitées que Bubble

Difficile de créer des workflows vraiment complexes

Moins adapté pour des applications transactionnelles intenses

Mon conseil : Softr est idéal pour des portails internes, des intranets d’équipe, des bases de connaissances, ou des CRM simples. Si votre logique métier est essentiellement « afficher, filtrer et éditer des données », Softr est parfait. Je l’utilise pour environ 25% de mes projets, particulièrement ceux avec des délais serrés.

Glide : Applications mobiles à partir de Google Sheets

Glide transforme vos Google Sheets en applications mobiles natives. C’est presque magique la première fois que vous l’utilisez. Vous avez un Google Sheet avec des données ? En 30 minutes, vous avez une app mobile fonctionnelle que vos utilisateurs peuvent installer sur leurs téléphones.

Ce que j’aime chez Glide :

La simplicité absolue pour démarrer

Les apps sont vraiment belles et modernes

Parfait pour les équipes déjà habituées à Google Sheets

Les mises à jour de données sont instantanées

Excellent pour des cas d’usage mobiles spécifiques

Les limitations :

Google Sheets n’est pas conçu comme une vraie base de données, donc limitations de performance

Moins flexible que Bubble pour des logiques complexes

Principalement orienté mobile (versions web possibles mais limitées)

Peut devenir confus avec des sheets très complexes

Mon conseil : Glide est fantastique pour des applications mobiles simples destinées à des équipes terrain : catalogues produits, annuaires, inventaires, checklists, inspections, etc. Je l’utilise pour environ 15% de mes projets, principalement ceux avec un fort besoin mobile.

b. Automation Avancée : Le Système Nerveux de Votre Infrastructure

L’automatisation, c’est ce qui transforme une collection d’outils en une véritable infrastructure d’instrumentation intelligente. C’est le tissu connectif qui fait communiquer vos différents systèmes et orchestre les workflows. J’utilise quotidiennement ces deux plateformes, chacune avec ses forces.

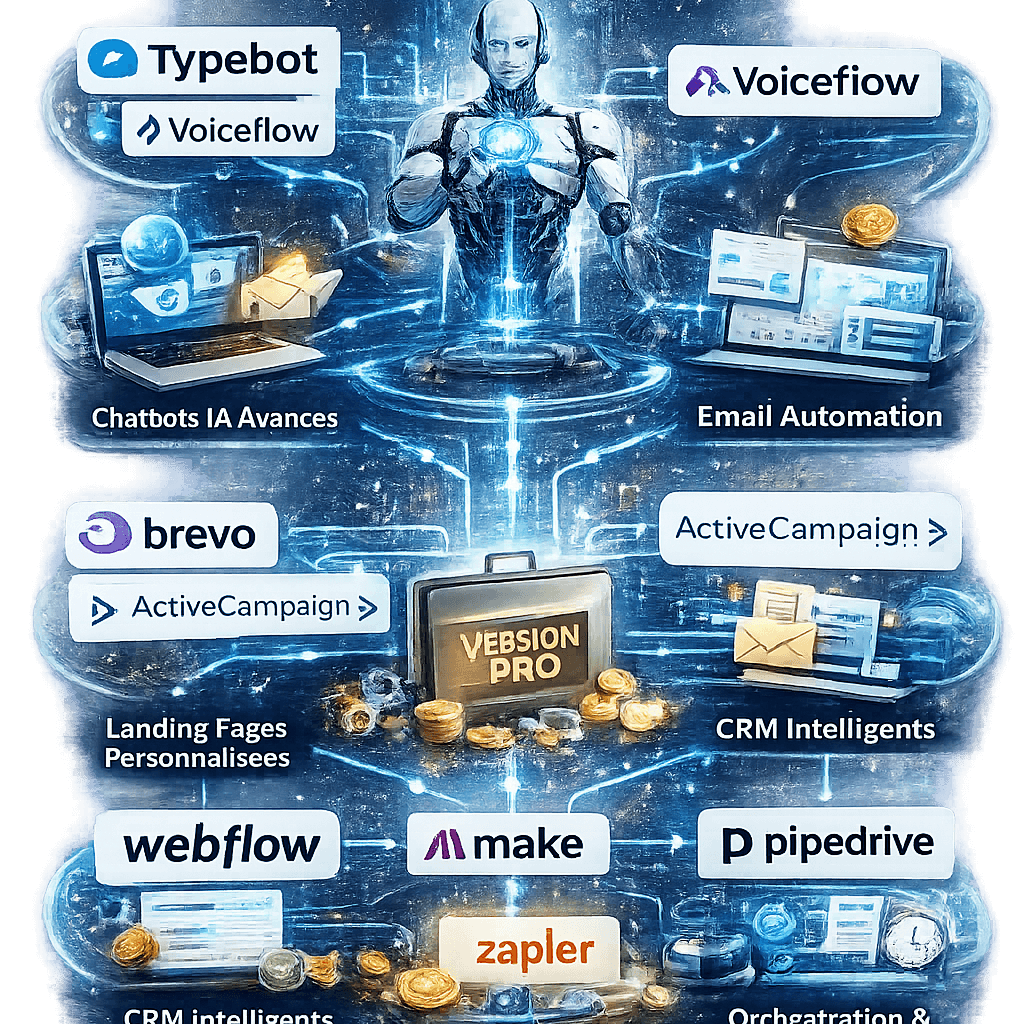

Make (anciennement Integromat) : Mon outil d’automation préféré

Make est devenu absolument indispensable dans mon travail. C’est une plateforme d’automatisation visuelle qui vous permet de créer des « scénarios » connectant des centaines d’applications différentes. Ce qui rend Make si puissant, c’est sa flexibilité et sa capacité à gérer des logiques vraiment complexes.

Pourquoi je préfère Make :

L’interface visuelle est intuitive et puissante

Les possibilités de transformation des données sont quasi-infinies

Le pricing basé sur les « opérations » est généralement plus économique que Zapier

Les fonctionnalités de debugging sont excellentes

Intégration native avec des centaines d’apps et possibilité d’appeler n’importe quelle API

Mes cas d’usage préférés avec Make :

Synchroniser automatiquement les données entre CRM, outils marketing et comptabilité

Créer des workflows d’approbation complexes avec branches conditionnelles

Générer et envoyer des documents personnalisés (contrats, factures, rapports)

Surveiller des sources de données et déclencher des alertes selon des conditions spécifiques

Connecter des agents IA à vos applications pour ajouter des capacités intelligentes

Un exemple concret : j’ai créé un scénario Make qui surveille notre CRM pour les nouveaux leads. Quand un lead entre, le scénario :

Enrichit automatiquement les données du lead via des APIs d’enrichissement

Calcule un score de qualification basé sur plusieurs critères

Si le score est élevé, crée automatiquement une tâche pour le commercial le plus approprié

Envoie une séquence d’emails personnalisés selon le profil du lead

Met à jour le dashboard en temps réel

Si aucune réponse après 7 jours, escalade vers le manager

Tout ça se passe automatiquement, 24/7, sans intervention humaine. Ce scénario nous fait gagner facilement 10 heures par semaine.

Les limitations de Make :

La courbe d’apprentissage n’est pas triviale

Pour des scénarios très complexes, le debugging peut devenir difficile

Certaines intégrations natives sont moins abouties que chez Zapier

Les erreurs dans les scénarios peuvent parfois être obscures

Mon conseil : Investissez du temps pour vraiment apprendre Make. Les premières heures seront frustrantes, mais une fois que vous maîtrisez les concepts de base (modules, routes, itérateurs, agrégateurs), vous devenez capable d’automatiser pratiquement n’importe quoi. Je recommande de commencer par des scénarios simples et de complexifier progressivement.

n8n : L’alternative open-source pour les projets critiques

n8n est une plateforme d’automatisation similaire à Make, mais open-source. Vous pouvez l’héberger vous-même, ce qui vous donne un contrôle total et évite les coûts récurrents pour des volumes importants. J’utilise n8n principalement pour les projets où la souveraineté des données est critique ou où les volumes d’opérations sont très élevés.

Les avantages de n8n :

Open-source, donc personnalisable à l’infini

Hébergement on-premise possible pour les données sensibles

Pas de limitations de volume si vous l’hébergez vous-même

Communauté active et en croissance

Possibilité d’ajouter vos propres nodes personnalisés

Les défis avec n8n :

Nécessite des compétences techniques pour l’hébergement et la maintenance

Moins d’intégrations natives que Make ou Zapier

Interface moins polie

Support communautaire plutôt que support commercial

Mon conseil : Si vous avez des compétences techniques dans votre équipe ou si vous prévoyez des volumes vraiment importants d’automatisations, n8n est une excellente option qui peut vous faire économiser beaucoup sur le long terme. Pour la plupart des projets, je recommande cependant de commencer avec Make qui est plus simple et rapide à mettre en place.

c. APIs et Intégrations : Connecter l’Inconectable

Parfois, vos outils existants n’ont pas d’intégration native ou vous devez créer des connexions vraiment personnalisées. C’est là que les APIs et les intégrations custom entrent en jeu. Même sans être développeur, vous pouvez faire énormément grâce aux outils modernes.

Zapier : La simplicité pour débuter

Zapier est probablement la plateforme d’automatisation la plus connue. Son principal avantage est sa simplicité extrême et ses milliers d’intégrations pré-construites. Si vous débutez dans l’automatisation, Zapier est souvent le meilleur point de départ.

Quand j’utilise Zapier plutôt que Make :

Pour des automatisations très simples (1 trigger → 1-3 actions)

Quand l’application que je veux connecter n’est disponible que sur Zapier

Pour des projets où je veux minimiser la courbe d’apprentissage pour mon client

Quand le volume d’opérations est faible et que le coût n’est pas un problème

Les inconvénients de Zapier :

Beaucoup plus cher que Make pour des volumes importants

Moins flexible pour des logiques complexes

Les « multi-step Zaps » deviennent vite confus

Difficile de débugger quand ça ne fonctionne pas comme prévu

Mon conseil honnête : Zapier est excellent pour découvrir le monde de l’automatisation et pour des cas d’usage simples. Mais si vous prévoyez de construire une vraie infrastructure d’instrumentation , vous allez rapidement buter sur ses limitations et son coût. Je l’utilise pour moins de 10% de mes projets aujourd’hui, principalement quand je dois absolument utiliser une app qui n’existe que sur Zapier.

Custom code : Quand rien d’autre ne suffit

Malgré la puissance des outils no-code, il y a des situations où vous devez vraiment écrire du code personnalisé. Les cas les plus fréquents dans mon expérience :

Algorithmes de calcul très spécifiques à votre métier

Intégration avec des systèmes legacy propriétaires

Besoins de performance extrême

Traitement de données complexe avec l’ intelligence artificielle

Pour ces situations, je fais généralement appel à des développeurs spécialisés ou j’utilise des plateformes low-code qui permettent d’insérer du code custom quand nécessaire. Bubble, par exemple, permet d’ajouter des plugins JavaScript personnalisés. Make et n8n permettent d’exécuter du code Python ou Node.js dans vos workflows.

Ma stratégie hybride no-code/code : Je commence toujours par une approche no-code pour valider le concept et créer un MVP rapidement. Une fois que je sais que ça fonctionne et génère de la valeur, j’identifie les goulots d’étranglement ou les limitations, et c’est là que j’ajoute du code custom uniquement où c’est nécessaire. Cette approche « no-code first, code when needed » me permet d’avancer rapidement tout en gardant la flexibilité pour optimiser.

Par exemple, sur un projet récent, j’ai construit 90% de l’application en no-code avec Bubble, mais j’ai ajouté un plugin custom en JavaScript pour gérer des calculs financiers complexes qui auraient été trop lents avec la logique native de Bubble. Le résultat final était aussi performant qu’une application entièrement codée, mais développé en un quart du temps.

Intégrer des agents IA via APIs : Un des cas d’usage les plus excitants aujourd’hui est l’intégration d’ agents IA dans vos workflows via leurs APIs. Des services comme OpenAI (GPT), Anthropic (Claude), Google (Gemini) ou des solutions spécialisées offrent des APIs puissantes que vous pouvez appeler depuis vos outils no-code.

J’ai créé récemment un système où un agent IA analyse automatiquement les emails entrants d’un service client, extrait les informations clés, catégorise la demande, suggère une réponse, et crée automatiquement un ticket dans le système de gestion. Tout ça en appelant simplement l’API OpenAI depuis un scénario Make. L’ intelligence artificielle traite des tâches qui auraient nécessité des heures de programmation complexe.

d. Bases de Données : Le Cœur de Votre Infrastructure

Vos données sont l’actif le plus précieux de votre infrastructure d’instrumentation . Le choix de votre solution de base de données va déterminer la flexibilité, la performance et la scalabilité de tout votre système. Voici mes recommandations basées sur des années d’expérience.

Airtable : Ma base de données favorite pour 80% des projets

Je dois l’avouer, j’ai une véritable passion pour Airtable. C’est un hybride fascinant entre une feuille de calcul et une vraie base de données relationnelle. L’interface est tellement intuitive que même des personnes sans aucune connaissance technique peuvent créer et gérer des bases de données complexes.

Pourquoi Airtable est devenu mon choix par défaut :

Interface visuelle magnifique qui rend les données compréhensibles instantanément

Relations entre tables super simples à créer et gérer

Vues multiples (grille, kanban, calendrier, galerie, formulaire) pour visualiser vos données différemment

API robuste pour connecter avec n’importe quel outil

Extensions et automatisations intégrées

Collaboration en temps réel comme Google Sheets

Templates excellents pour démarrer rapidement

Mes cas d’usage préférés avec Airtable :

CRM personnalisés avec pipeline de ventes

Bases de connaissances et documentation interne

Gestion de projets et suivi de tâches

Inventaires et catalogues produits

Bases de données clients avec historique complet

Systèmes de ticketing support client

Un exemple concret de ma propre utilisation : je gère toute mon activité de conseil sur Airtable. J’ai une base qui contient mes clients, mes projets, mes tâches, mes factures, mes contacts, mes idées de contenu, mes formations… Tout est interconnecté. Par exemple, quand je crée un nouveau projet, il est automatiquement lié au client, les tâches associées sont générées automatiquement selon le type de projet, et je peux instantanément voir la charge de travail prévue sur mon calendrier. Cela m’a fait gagner probablement 5 heures par semaine en gestion administrative.

Les limitations d’Airtable :

Pas adapté pour des volumes vraiment massifs (> 50 000 enregistrements par base)

Performance qui peut ralentir sur des bases très complexes

Coût qui augmente avec le nombre d’utilisateurs et les fonctionnalités avancées

Moins de contrôle granulaire sur les permissions que des bases de données traditionnelles

Certaines requêtes complexes sont impossibles ou laborieuses

Mon conseil : Pour 80% des besoins en bases de données dans le contexte de micro-SaaS et d’outils sur mesure, Airtable est le choix idéal. Commencez avec Airtable et migrez vers une solution plus technique seulement si vous rencontrez vraiment ses limites. J’utilise Airtable dans pratiquement tous mes projets.

Supabase : La puissance de PostgreSQL avec la simplicité du no-code

Quand Airtable ne suffit plus (volumes très importants, logique complexe, besoins de performance élevée), je me tourne vers Supabase. C’est une alternative open-source à Firebase qui vous donne une vraie base de données PostgreSQL avec une interface moderne et des APIs automatiquement générées.

Les avantages de Supabase :

Base de données PostgreSQL complète avec toutes ses capacités

APIs RESTful et GraphQL générées automatiquement

Authentification et gestion des utilisateurs intégrée

Storage pour fichiers et médias

Fonctions serverless pour logique backend personnalisée

Temps réel et subscriptions aux changements de données

Open-source donc hébergeable vous-même si nécessaire

Quand j’utilise Supabase plutôt qu’Airtable :

Volumes de données importants (centaines de milliers d’enregistrements)

Besoins de requêtes SQL complexes

Applications nécessitant des performances élevées

Projets où la structure de données va évoluer fréquemment

Quand j’ai besoin de fonctionnalités backend avancées

Les défis avec Supabase :

Courbe d’apprentissage plus raide (nécessite de comprendre SQL)

Interface moins intuitive qu’Airtable pour les non-techniques

Nécessite plus de configuration initiale

Moins de visualisations natives des données

Mon conseil : Si votre équipe a des compétences techniques ou si vous prévoyez de scaler significativement, Supabase est un excellent choix qui vous donnera la puissance d’une vraie base de données sans la complexité du setup traditionnel. Pour les projets avec des agents IA qui traitent beaucoup de données, Supabase est souvent préférable à Airtable.

e. Développement et Intégration d’Agents IA : L’Avenir de l’Infrastructure d’Instrumentation

L’intégration des agents IA dans votre infrastructure d’instrumentation est ce qui transforme un système fonctionnel en un système vraiment intelligent. Les intelligences artificielles ne sont plus réservées aux grandes entreprises tech. Aujourd’hui, même les petites équipes peuvent intégrer des capacités IA sophistiquées dans leurs outils sur mesure.

React et frameworks modernes pour interfaces utilisateur

Quand les plateformes no-code ne suffisent pas pour créer l’interface utilisateur que vous imaginez, React et les frameworks JavaScript modernes deviennent nécessaires. Je dois avouer que je ne code pas moi-même en React, mais je collabore régulièrement avec des développeurs pour créer des interfaces personnalisées quand c’est nécessaire.

React est devenu le standard de facto pour créer des interfaces web modernes et réactives. Sa force est sa modularité : vous créez des composants réutilisables qui s’assemblent comme des briques LEGO. Pour des projets d’ infrastructure d’instrumentation complexes, React permet de créer des expériences utilisateur vraiment sophistiquées.

Les frameworks basés sur React que je recommande :

Next.js : Parfait pour des applications full-stack avec SEO important

Remix : Excellent pour des applications avec beaucoup d’interactions serveur

React Native : Pour créer des applications mobiles natives iOS et Android

Mon approche : J’utilise React seulement quand les outils no-code ne permettent pas de créer l’expérience utilisateur exacte dont j’ai besoin. Par exemple, pour un dashboard très interactif avec des graphiques complexes en temps réel, React avec des bibliothèques comme D3.js ou Recharts devient nécessaire. Mais pour 70% de mes projets, les outils no-code suffisent largement.

Python pour traitement de données et intelligence artificielle

Python est devenu le langage de prédilection pour tout ce qui touche au traitement de données et à l’ intelligence artificielle . Si vous voulez intégrer des agents IA sophistiqués, créer des modèles de machine learning personnalisés, ou faire de l’analyse de données avancée, Python est incontournable.

Dans mes projets d’ infrastructure d’instrumentation , j’utilise Python pour :

Scripts d’ETL (Extract, Transform, Load) pour nettoyer et transformer des données

Création de modèles de machine learning personnalisés quand les APIs standards ne suffisent pas

Automatisations complexes qui nécessitent des bibliothèques Python spécifiques

Intégration avec des agents IA via des frameworks comme LangChain ou LlamaIndex

Analyses statistiques avancées et data science

Un exemple récent : j’ai créé un script Python qui analyse les conversations de support client pour identifier automatiquement les sujets récurrents, les sentiments des clients, et les opportunités d’amélioration produit. Le script utilise des agents IA (via l’API OpenAI) pour comprendre le contexte des conversations, puis génère automatiquement des rapports hebdomadaires avec des insights actionnables. Ce système a transformé des centaines d’heures de lecture manuelle en un processus automatisé de 15 minutes.

LangChain et frameworks d’agents IA

C’est probablement le domaine qui évolue le plus rapidement en ce moment. LangChain est un framework open-source qui facilite énormément la création d’applications utilisant des agents IA . Il permet de chaîner différents modèles d’ intelligence artificielle , de leur donner accès à des outils, et de créer des workflows complexes.

Ce que LangChain permet de faire facilement :

Créer des chatbots qui peuvent accéder à vos données propriétaires

Construire des agents IA qui utilisent plusieurs outils (recherche web, APIs, bases de données)

Implémenter des systèmes RAG (Retrieval-Augmented Generation) pour que l’IA utilise vos documents

Créer des pipelines de traitement de texte sophistiqués

Orchestrer plusieurs agents IA qui collaborent sur des tâches complexes

Un cas d’usage concret : j’ai développé un assistant IA pour une entreprise de services juridiques. L’ agent IA peut répondre aux questions des clients en se basant sur la documentation juridique de l’entreprise, créer des brouillons de documents personnalisés, et même suggérer des stratégies basées sur des cas similaires passés. Tout ça grâce à LangChain qui orchestre l’accès à différentes sources de données et différents modèles d’ intelligence artificielle .

Les alternatives à LangChain :

LlamaIndex : Spécialisé dans l’indexation et la recherche dans vos propres documents

Haystack : Excellent pour des pipelines de traitement de langage naturel

AutoGPT : Pour créer des agents autonomes qui peuvent accomplir des tâches complexes

Mon conseil : Si vous voulez intégrer des capacités d’ IA avancées dans votre infrastructure d’instrumentation , investissez du temps pour comprendre ces frameworks. Ils vous permettent de faire en quelques lignes de code ce qui aurait nécessité des mois de développement il y a seulement deux ans. Même si vous n’êtes pas développeur, comprendre ces concepts vous permet de mieux collaborer avec des experts et de savoir ce qui est possible.

Intégration d’agents IA dans vos workflows

La vraie magie opère quand vous intégrez des agents IA directement dans vos workflows quotidiens. Plutôt que d’avoir l’IA comme un outil séparé, elle devient un membre invisible de votre équipe qui travaille 24/7.

Voici comment j’intègre concrètement les agents IA dans les infrastructures d’instrumentation que je crée :

1. Automatisation intelligente des tâches répétitives Un agent IA peut analyser des documents entrants (emails, factures, contrats), extraire les informations importantes, les catégoriser, et les router vers les bonnes personnes ou systèmes. J’ai mis en place ce système pour plusieurs clients, et cela réduit typiquement de 70% le temps passé sur ces tâches administratives.

2. Assistance en temps réel pour les décisions Plutôt que de simplement afficher des données, l’ intelligence artificielle peut analyser la situation et suggérer des actions. Par exemple, dans un CRM que j’ai développé, l’ agent IA suggère automatiquement le meilleur moment pour contacter un prospect, le message le plus approprié, et même prédit la probabilité de conversion.

3. Détection proactive de problèmes Les agents IA surveillent continuellement vos données et vous alertent quand ils détectent des anomalies ou des opportunités. J’ai implémenté un système qui analyse les KPI d’une entreprise en temps réel et envoie des alertes intelligentes seulement quand quelque chose nécessite vraiment l’attention humaine. Fini les dashboards qu’on ne regarde jamais.

4. Personnalisation à grande échelle L’ IA permet de personnaliser vos communications et interactions à un niveau impossible manuellement. Un agent IA peut analyser le profil, l’historique et le comportement de chaque client pour personnaliser automatiquement chaque interaction. J’ai vu des taux d’engagement multiplier par 3-4 grâce à cette personnalisation intelligente.

5. Apprentissage et amélioration continue Le plus excitant avec les agents IA , c’est qu’ils apprennent et s’améliorent avec le temps. Plus votre système traite de données, plus l’ intelligence artificielle devient précise dans ses prédictions et suggestions. C’est comme avoir un employé qui devient exponentiellement meilleur chaque jour.

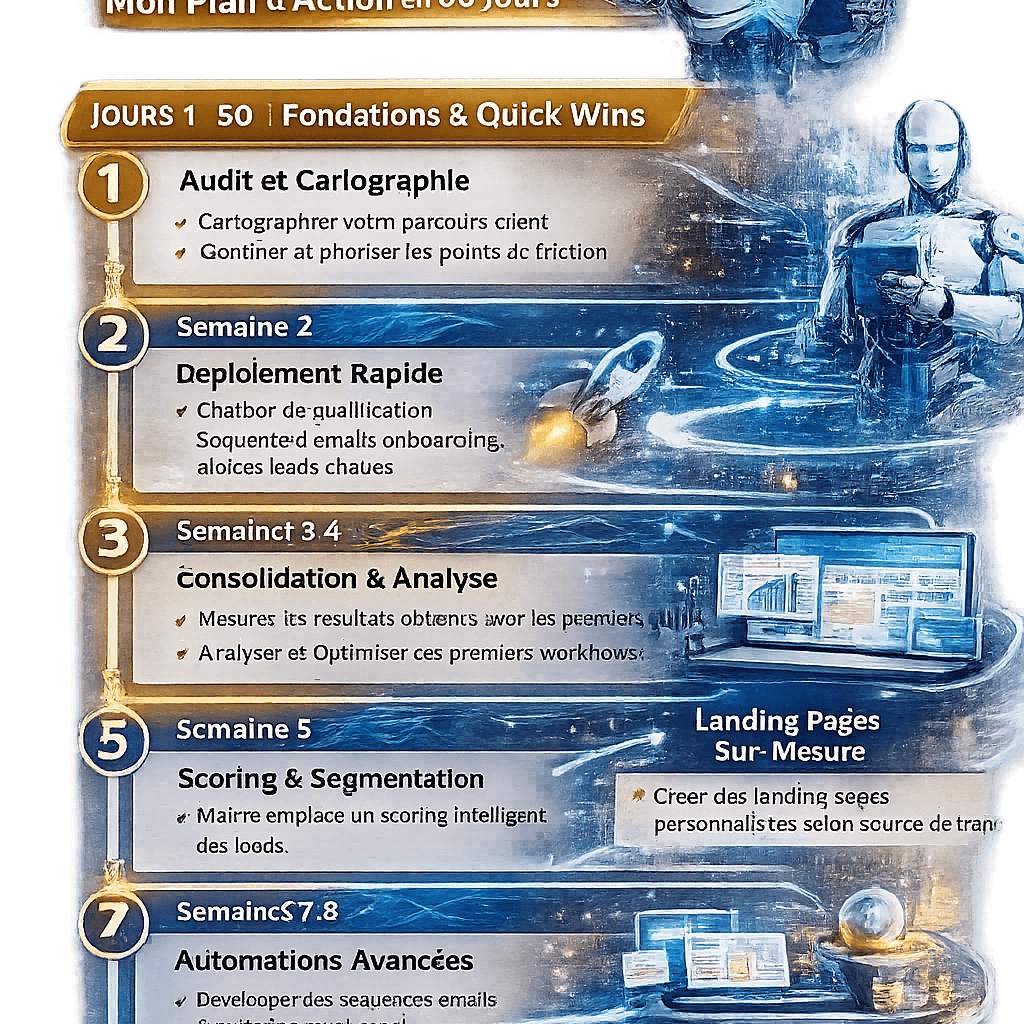

6. Méthodologie de Création : De l’Idée à la Réalité en 6 Étapes

Après avoir créé des dizaines d’outils sur mesure et d’ infrastructures d’instrumentation , j’ai développé une méthodologie éprouvée qui maximise les chances de succès tout en minimisant le temps et les ressources nécessaires. Cette approche itérative et centrée sur la valeur m’a permis d’éviter les pièges classiques qui font échouer tant de projets.

Laissez-moi vous guider à travers les six étapes que je suis systématiquement pour transformer une idée d’outil sur mesure en une réalité opérationnelle qui génère de la valeur.

a. Étape 1 : Discovery et Définition du Besoin Réel

La première erreur que j’ai commise dans mes débuts était de sauter directement sur la solution technique sans vraiment comprendre le problème. J’étais tellement excité par les possibilités des outils no-code et des agents IA que je perdais de vue l’essentiel : résoudre un vrai problème métier.

Aujourd’hui, je consacre systématiquement 20 à 30% du temps total du projet à cette phase de discovery. C’est un investissement qui se rentabilise largement en évitant de construire la mauvaise chose.

Ma méthode de discovery en 5 questions Question 1 : Quel est le problème exact que vous essayez de résoudre ? Pas la solution que vous imaginez, mais le problème réel. Je demande toujours des exemples concrets, des situations frustrantes vécues récemment. « Je veux un CRM » n’est pas un problème, c’est une solution présumée. Le problème est peut-être « Je perds des opportunités commerciales parce que je ne sais pas qui dans mon équipe a contacté quel prospect et quand. »

Question 2 : Qui est impacté par ce problème et comment ? Identifiez tous les stakeholders : utilisateurs finaux, managers, clients, partenaires. Chacun a une perspective différente. J’organise toujours des interviews avec plusieurs personnes de différents niveaux pour avoir une vision complète. Souvent, ce que la direction pense être le problème n’est pas du tout ce que vivent les opérationnels.

Question 3 : Quelle est l’ampleur de ce problème ? Quantifiez autant que possible. Combien de temps est perdu ? Combien de revenus sont manqués ? Combien d’erreurs sont commises ? Ces chiffres vous permettront de mesurer le ROI de votre solution et de prioriser les fonctionnalités.

Un exemple : Un client me disait « On perd trop de temps en réunions. » Trop vague. En creusant, j’ai découvert qu’ils passaient collectivement 47 heures par semaine en réunions de synchronisation pour partager des informations qui auraient pu être communiquées autrement. Avec ce chiffre précis, on pouvait calculer que même une réduction de 50% représentait 24 heures hebdomadaires, soit l’équivalent d’un demi-employé à temps plein.

Question 4 : Qu’avez-vous déjà essayé pour résoudre ce problème ? Cette question révèle souvent beaucoup. Pourquoi les solutions précédentes ont échoué ? Était-ce un problème d’adoption, de fonctionnalités manquantes, de complexité excessive ? Ces leçons sont précieuses pour éviter de répéter les mêmes erreurs.

Question 5 : À quoi ressemble le succès dans 6 mois ? Demandez une vision concrète et mesurable. « Être plus productifs » n’est pas un objectif. « Réduire de 50% le temps de traitement des commandes, passer de 30 à 15 minutes en moyenne » en est un. Cette vision guide ensuite tout le développement.

Créer une User Story Map

Une fois que j’ai collecté toutes ces informations, je crée ce qu’on appelle une User Story Map. C’est une visualisation de tous les parcours utilisateurs, étape par étape, avec les pain points identifiés à chaque étape.

Par exemple, pour un outil de gestion de projets sur mesure, ma User Story Map pourrait ressembler à :

Création du projet → Pain point : trop de champs à remplir, perd 20 minutes

Assignation des tâches → Pain point : ne sait pas qui est disponible, assignations sous-optimales

Suivi de l’avancement → Pain point : doit demander individuellement à chaque personne, consomme du temps

Identification des blocages → Pain point : découvre les problèmes trop tard

Livraison finale → Pain point : processus de validation confus, allers-retours inutiles

Cette visualisation me permet ensuite de prioriser quelles parties du parcours attaquer en premier avec ma solution.

b. Étape 2 : Conception et Prototypage Rapide

Une fois le besoin clairement défini, je passe à la phase de conception. Mais attention, je ne parle pas de créer des spécifications détaillées de 50 pages. Je parle de prototyper rapidement pour valider les concepts avant d’investir dans le développement.

Le Wireframing minimaliste

Je commence toujours par des wireframes super simples. Pas besoin d’outils sophistiqués, un papier et un crayon suffisent souvent. Je dessine l’interface principale, les écrans clés, les flux de navigation. L’objectif n’est pas la beauté, mais la clarté fonctionnelle.

Ces wireframes, je les partage immédiatement avec les futurs utilisateurs pour obtenir du feedback. « Est-ce que cette organisation fait sens ? Est-ce que vous trouveriez facilement cette information ? Est-ce que ce workflow correspond à votre manière de travailler ? »

J’ai appris qu’il vaut mieux passer 2 heures sur un wireframe papier et le jeter si ça ne convient pas, plutôt que de passer 2 semaines à développer une interface pour découvrir qu’elle ne correspond pas aux besoins.

Le Prototype Cliquable

Une fois les wireframes validés, je crée un prototype cliquable avec un outil comme Figma ou même simplement avec Google Slides. L’idée est de simuler l’expérience utilisateur sans rien coder.

Ce prototype me permet de tester :

L’ergonomie : les utilisateurs arrivent-ils à accomplir leurs tâches intuitivement ?

Le vocabulaire : les termes utilisés sont-ils compris par tous ?

Les flux : les parcours sont-ils logiques et efficaces ?

Les priorités : les informations les plus importantes sont-elles immédiatement visibles ?

Je fais tester ce prototype par 3 à 5 utilisateurs réels. Je leur donne des scénarios (« Imagine que tu veux créer un nouveau projet pour le client XYZ… ») et je les observe naviguer dans le prototype. Les insights que vous obtenez à ce stade sont inestimables.

Définir le MVP (Minimum Viable Product)

L’erreur classique est de vouloir construire immédiatement l’outil complet avec toutes les fonctionnalités imaginables. J’ai commis cette erreur plusieurs fois, et chaque fois, j’ai regretté.

Aujourd’hui, je définis toujours un MVP : la version minimale qui résout le problème principal et génère de la valeur mesurable. Tout le reste peut attendre.

Ma règle du 80/20 appliquée au MVP : identifiez les 20% de fonctionnalités qui vont résoudre 80% du problème. C’est ça votre MVP. Le reste, vous l’ajouterez progressivement basé sur les retours d’utilisation réels, pas sur les suppositions.

Par exemple, pour un CRM sur mesure, mon MVP pourrait inclure :

Création et gestion des contacts

Suivi simple des opportunités

Historique des interactions

Dashboard basique avec les KPI essentiels

Mais exclure dans un premier temps :

Génération automatique de documents

Intégrations complexes avec la comptabilité

Rapports avancés personnalisables

Application mobile

Ces fonctionnalités viendront plus tard, une fois que le cœur du système fonctionne et génère de la valeur.

c. Étape 3 : Développement Itératif en Sprints Courts

Le développement lui-même, je l’organise en sprints de deux semaines maximum. Chaque sprint doit livrer quelque chose de fonctionnel et testable. Cette approche itérative présente plusieurs avantages énormes.

Sprint 1 : Les fondations

Le premier sprint se concentre sur la structure de base et les fonctionnalités core. Par exemple, pour un outil de gestion de contenu :

Setup de la base de données Airtable avec les tables principales

Création de l’interface Bubble de base

Implémentation du workflow de création d’article basique

Connexion entre Bubble et Airtable

À la fin de ce sprint, vous avez quelque chose de rudimentaire mais qui fonctionne. Vous pouvez créer un article, le voir dans la liste, l’éditer. C’est moche, c’est incomplet, mais ça prouve le concept.

Sprint 2 : Les workflows principaux

Le deuxième sprint ajoute les workflows métier importants :

Système d’assignation des articles aux rédacteurs

Workflow de validation

Notifications automatiques

Intégration Make pour les automatisations basiques

À la fin, vous avez un système fonctionnel pour le parcours principal. Certains cas edge ne sont pas gérés, certaines fonctionnalités manquent, mais 80% du processus métier est couvert.

Sprint 3 : L’intelligence et l’expérience utilisateur

Le troisième sprint améliore l’expérience et ajoute l’intelligence :

Intégration d’un agent IA pour suggestions et automatisations

Amélioration de l’interface utilisateur

Dashboard et visualisations

Gestion des cas particuliers

Les sprints suivants : Amélioration continue

Les sprints suivants se basent sur les retours d’utilisation réelle. C’est là que la magie opère : vous ne devinez plus ce dont les utilisateurs ont besoin, ils vous le disent en utilisant le système.

Cette approche itérative a un avantage psychologique immense : les utilisateurs voient des progrès constants. Chaque deux semaines, il y a des améliorations visibles. Cela maintient l’engagement et l’enthousiasme, contrairement aux projets où on ne voit rien pendant des mois puis on dévoile tout d’un coup.

Ma routine de développement quotidienne

Quand je développe activement sur un projet, voici ma routine :